O impacto da IA na Europa

Em maio de 2022 a União Europeia (UE) publicava o relatório sobre o resultado final da “Conferência sobre o Futuro da Europa”.

A Conferência sobre o Futuro da Europa consistiu numa série de debates liderados pelos cidadãos que permitiram às pessoas de toda a Europa partilhar as suas ideias e ajudar a construir um futuro comum. Durou um ano, de abril de 2021 a maio de 2022 foram apresentadas aos presidentes do Parlamento Europeu, do Conselho e da Comissão Europeia:

No contexto da cibersegurança fica importante reter da proposta 27 o objetivo de “combater a desinformação através de uma maior promoção da independência e do pluralismo dos meios de comunicação social, bem como da literacia mediática (…)”, a 28 o objetivo “Um papel mais forte da UE na luta contra as ameaças à cibersegurança (…)”, a 33 o objetivo de assegurar “uma aplicação rápida e eficaz da legislação em vigor e tenha mais poderes para reforçar a cibersegurança, lidar com os conteúdos ilegais e a cibercriminalidade, combater e recuperar de ciberameaças de intervenientes não estatais e Estados autoritários, e combater a desinformação” e a 34 o objetivo de promover “uma maior sensibilização e uma aplicação e execução mais eficientes das regras em vigor em matéria de proteção de dados (RGPD) (…)”.

Algumas das medidas contemplavam: Reforçar a Agência da UE para a Cibersegurança (ENISA) a fim de proteger mais as pessoas organizações e instituições contra a utilização da Inteligência Artificial para fins criminosos, Garantir a privacidade e segurança dos dados pessoais, Reforçar a coordenação das autoridades nacionais de cibersegurança, Reforçar a literacia digital, o combate à desinformação e o discurso de ódio, Incentivar um sistema de certificação a nível europeu que reflita a conformidade com o RGPD de forma acessível clara e simples, entre outras.

Os riscos da IA

A Inteligência Artificial (IA) trouxe consigo uma série de benefícios e avanços significativos no nosso quotidiano. Tem o potencial para melhorar cuidados de saúde, tornar os transportes mais seguros e mais limpos, as produções mais eficientes, a energia mais barata e mais sustentável. No entanto, é crucial considerar também os desafios e perigos inerentes à mesma:

- Preconceitos e discriminação

Perpetua ou amplifica inadvertidamente preconceitos sociais devido a dados de treino tendenciosos, ou ao design algorítmico. Para minimizar a discriminação e garantir a justiça, é crucial investir no desenvolvimento de algoritmos imparciais e de data sets de treino diversificados.

- Preocupações com a privacidade

Recolhe e analisa frequentemente grandes quantidades de dados pessoais, levantando questões relacionadas com a privacidade e segurança dos dados. Para mitigar os riscos de privacidade, devemos defender regulamentos rigorosos de proteção de dados e práticas seguras no tratamento de dados.

- Riscos de segurança

Hackers e atores mal-intencionados podem aproveitar o poder da IA para desenvolver ataques cibernéticos mais avançados, contornar medidas de segurança e explorar vulnerabilidades em sistemas. Para mitigar estes riscos de segurança, os governos e as organizações devem realizar auditorias de segurança.

- Desinformação e manipulação

Os conteúdos gerados pela IA, como os deepfakes, contribuem para a difusão de informações falsas e para a manipulação da opinião pública. Os esforços para detetar e combater a desinformação gerada pela IA são fundamentais para preservar a integridade da informação na era digital. A exploração das vulnerabilidades dos utilizadores pode ser mitigada através de ações de formação e sensibilização.

- Desafios legais e regulatórios

É crucial desenvolver novos quadros jurídicos e regulamentos para abordar as questões únicas decorrentes das tecnologias de IA, incluindo a responsabilidade e os direitos de propriedade intelectual. Os sistemas jurídicos devem evoluir para acompanhar os avanços tecnológicos e proteger os direitos de todos.

Existem ainda vários riscos associados à IA que não serão abordados neste artigo. Caso tenha interesse, pode consultar o artigo “The 15 Biggest Risks of Artificial Intelligence ”.

Primeira regulamentação sobre Inteligência Artificial

No dia 13 de março de 2024 foi então aprovada (com 523 votos a favor, 46 contra e 49 abstenções) a primeira regulação sobre a Inteligência Artificial (IA). Este regulamento surge na tentativa de garantir a segurança e o respeito dos direitos fundamentais, mas coexistindo com o impulsionamento da inovação.

Proibição

As novas regras implicam a proibição de determinadas aplicações de IA que colocam em causa os direitos dos cidadãos. Essas proibições incluem:

- Sistemas de categorização biométrica baseados em características sensíveis;

- Recolha não direcionada de imagens faciais da Internet ou de televisão em circuito fechado para criar bases de dados de reconhecimento facial;

- Reconhecimento de emoções no local de trabalho e nas escolas;

- Classificação social;

- Policiamento preditivo (quando se baseia exclusivamente na definição de perfis de uma pessoa ou na avaliação das suas características);

- IA que manipula o comportamento humano ou explora as vulnerabilidades das pessoas.

Estão previstas exceções para fins de aplicação da lei à utilização de identificação biométrica à distância pelas autoridades policiais. A identificação em tempo real só pode ser aplicada se forem cumpridas as seguintes salvaguardas:

- Deve ser limitada no tempo e no âmbito geográfico;

- Deve estar sujeita a autorização judicial ou administrativa prévia específica.

Exemplos de uso incluem a busca seletiva de uma pessoa desaparecida ou a prevenção de um ataque terrorista. A utilização de sistemas de identificação biométrica à distância «em diferido» é considerada um caso de uso de alto risco.

Sistemas de alto risco

O AI Act, o quadro legal europeu para regular a utilização de inteligência artificial na União Europeia, estabelece obrigações claras para sistemas de IA de alto risco. Entende-se por alto risco:

- Infraestruturas críticas;

- Educação e formação profissional;

- Emprego;

- Serviços públicos e privados essenciais: inclui cuidados de saúde e serviços bancários;

- Sistemas de aplicação da lei;

- Migração e gestão das fronteiras;

- Justiça e processos democráticos: inclui eleições.

Devido aos seus potenciais danos estes sistemas devem:

- Avaliação e Redução de Riscos: Esses sistemas devem avaliar e mitigar os riscos associados.

- Registos de Utilização: Manter registos detalhados de como esses sistemas são usados.

- Transparência e Precisão: Devem ser transparentes e precisos.

- Supervisão Humana: Garantir que haja supervisão por pessoas, em vez de serem automatizados.

Os cidadãos terão o direito de apresentar queixas sobre os sistemas de IA e de receber explicações sobre as decisões baseadas em sistemas de IA de alto risco que afetem os seus direitos.

Requisitos de transparência

- Respeitar a legislação da UE sobre direitos de autor;

- Publicar informação detalhada dos conteúdos usados para treino.

Os modelos de IA de uso geral mais poderosos que possam colocar riscos sistémicos terão ainda de cumprir os seguintes requisitos:

- Realizar avaliações de modelos;

- Avaliar e atenuar os riscos e comunicar incidentes.

“O conteúdo que é gerado ou modificado com recurso à inteligência artificial como, por exemplo, as imagens, os arquivos de áudio ou vídeos (como é o caso dos deepfakes), precisa de ser claramente rotulado como sendo gerado através de inteligência artificial para que os utilizadores tenham consciência disso quando se veem confrontados com conteúdo desse género.”

Apoio à Inovação

Estão contempladas medidas de apoio à inovação e às Pequenas e Médias Empresas (PME), a nível nacional, estabelecendo ambientes de testes regulatórios em condições reais. Esses ambientes permitirão que as PME e as start-ups desenvolvam e treinem soluções de inteligência artificial inovadoras antes de lançá-las no mercado. Dessa forma, promove-se a adoção responsável e segura da IA, enquanto impulsiona o crescimento e a competitividade dessas empresas.

Próximas etapas

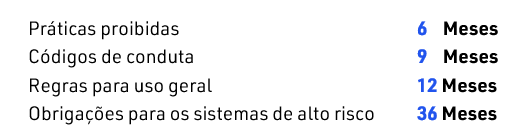

O regulamento ainda será aprovado e entrará em vigor 20 dias depois da sua publicação no Jornal Oficial do Parlamento Europeu. Será plenamente aplicável 24 meses após entrar em vigor exceto no que diz respeito a:

Espera-se que seja definitivamente adotado antes do término da legislatura, por meio do chamado “processo de retificação” depois de uma verificação final pelos juristas-linguistas. Além disso, a legislação ainda precisa receber apoio formal do Conselho.

Estão previstas multas para quem não cumprir as novas obrigações, com três escalões distintos:

- 35 milhões de euros (ou 7% do volume de negócios anual global da empresa) para violações das aplicações de IA proibidas.

- 15 milhões de euros (ou 3%) para violações das obrigações da lei de IA.

- 7,5 milhões de euros (ou 1,5%) para o fornecimento de informações incorretas.

E agora?

Embora a nova lei da UE seja crucial, não podemos depender exclusivamente dela. Aja agora para proteger os seus ativos contra as atuais e potenciais novas ameaças. Avalie as suas defesas contra as ciberameaças, invista em medidas proativas. Lembre-se de que a segurança e a proteção dos ativos da sua empresa são fundamentais para sucesso contínuo.

Autor do artigo: João Pereira - Pentester at Roboyo Portugal

Referências

Para mais informações contacte-nos.

MORADA

Rua Soares dos Reis, nº765 – 3

4400 – 317 Vila Nova de Gaia

Portugal

TELEFONE

+351 932 942 000 (custo de chamada para rede móvel nacional)

+351 223 744 827(custo de chamada para rede fixa nacional)

Artigos recentes

- EUVD: O Novo Pilar Europeu na Gestão de Vulnerabilidades

- ISO/IEC 42001: Guia Completo para o Sistema de Gestão de Inteligência Artificial (AIMS)

- [ALERTA] Vulnerabilidades em dispositivos Android

- ISO 23894: Como Gerir os Riscos da Inteligência Artificial na sua Empresa

- Assistentes virtuais e cibersegurança: como proteger os seus dados